1、前景回顾

FLUX Kontext Dev可以通过提示词,实现角色、物品、画面一致性,精准局部编辑,风格转换,融图效果等等。

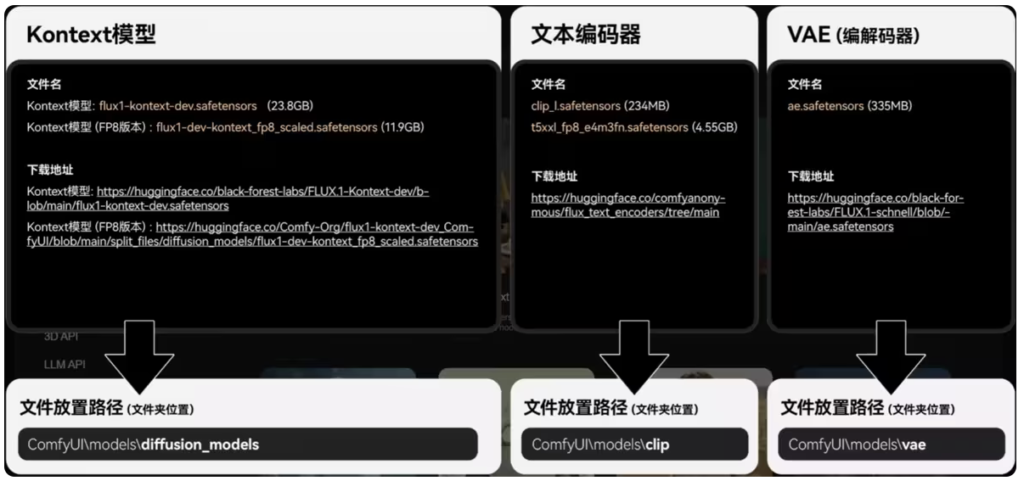

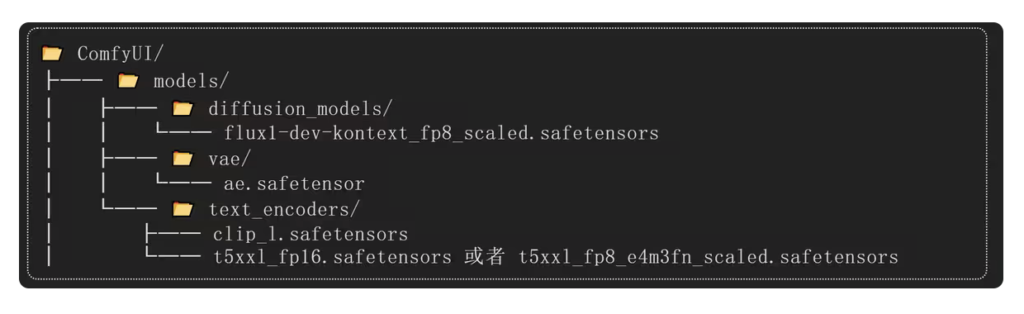

2、Kontext Dev模型下载

模型下载地址:

- 🔗Kontext模型:huggingface.co/black-forest-labs/FLUX.1-Kontext-dev/blob/main/flux1-kontext-dev.safetensors

- 🔗Kontext模型(FP8版本):huggingface.co/Comfy-Org/flux1-kontext-dev_ComfyUI/blob/main/split_files/diffusion_models/flux1-dev-kontext_fp8_scaled.safetensors

- (两个模型选其一下载即可,原版推荐24GB显存,FP8推荐16GB显存)

- 🔗文本编码器:huggingface.co/comfyanonymous/flux_text_encoders/tree/main

- 🔗VAE:huggingface.co/black-forest-labs/FLUX.1-schnell/blob/main/ae.safetensors

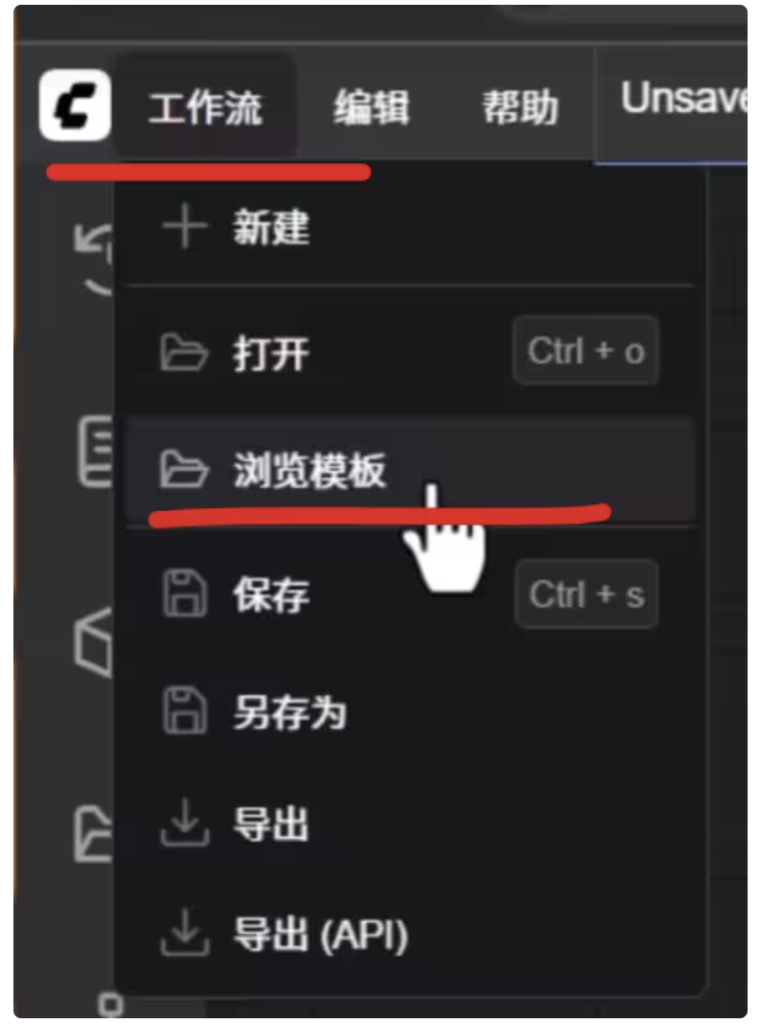

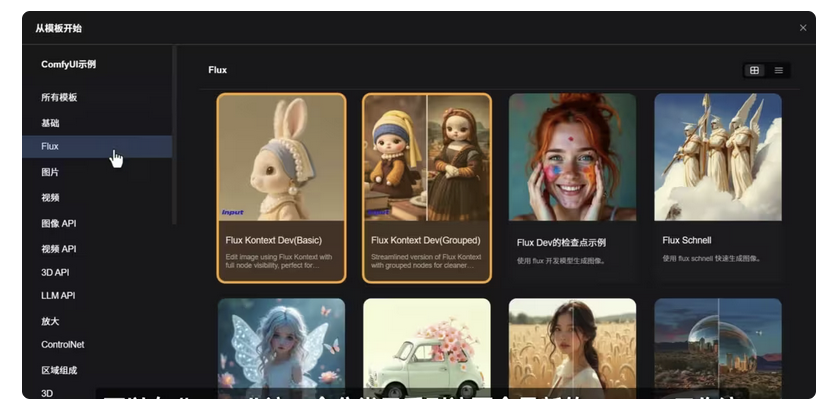

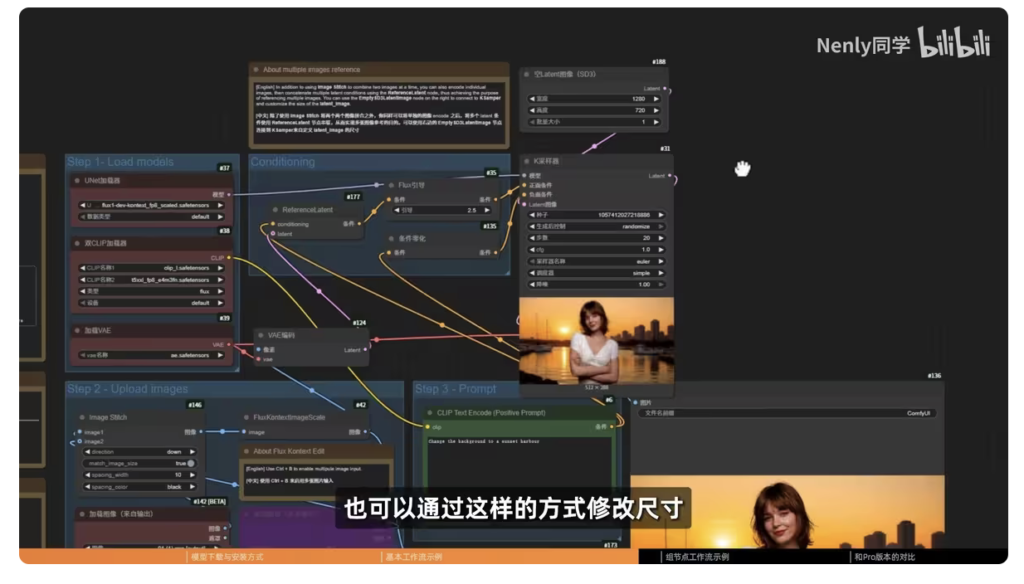

3、ComfyUI使用

ComfyUI 更新至最新版,左上角的工作流——浏览模板

可以在【FLUX】分类里找到FLUX Kontext Dev工作流。

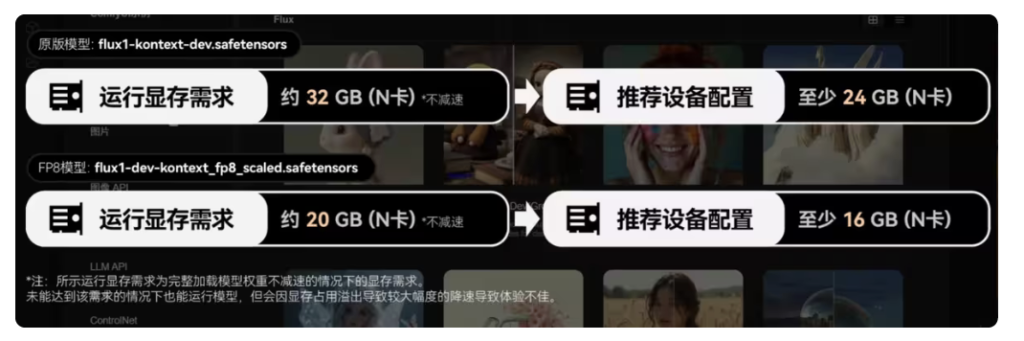

Kontext Dev配置需求

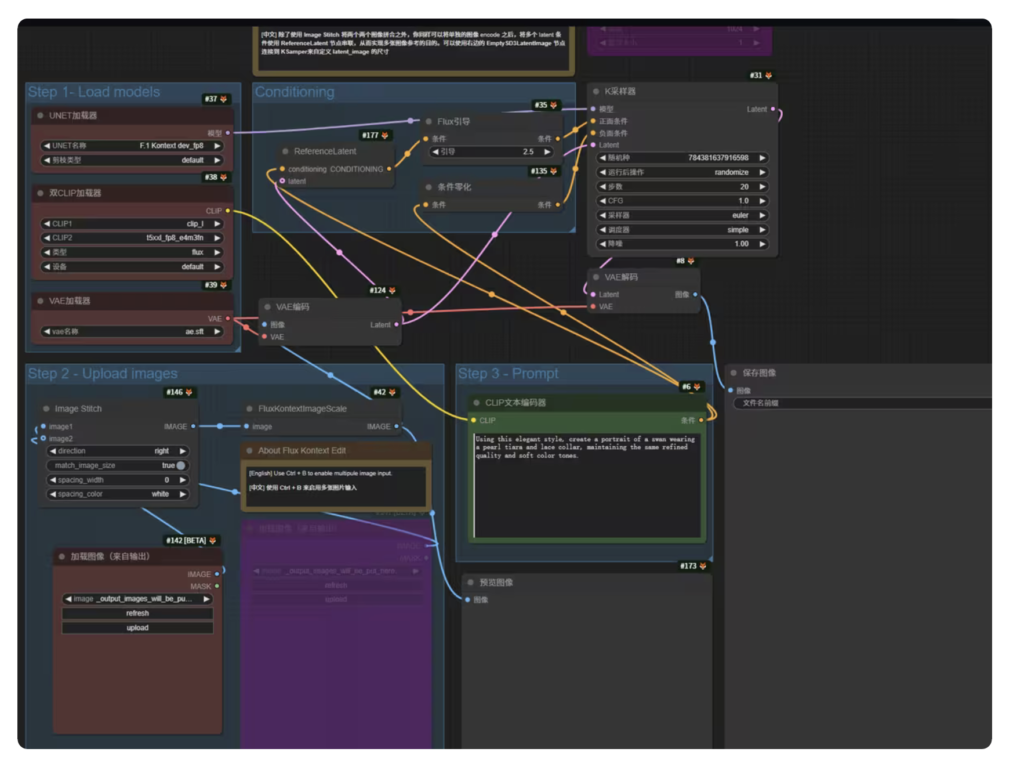

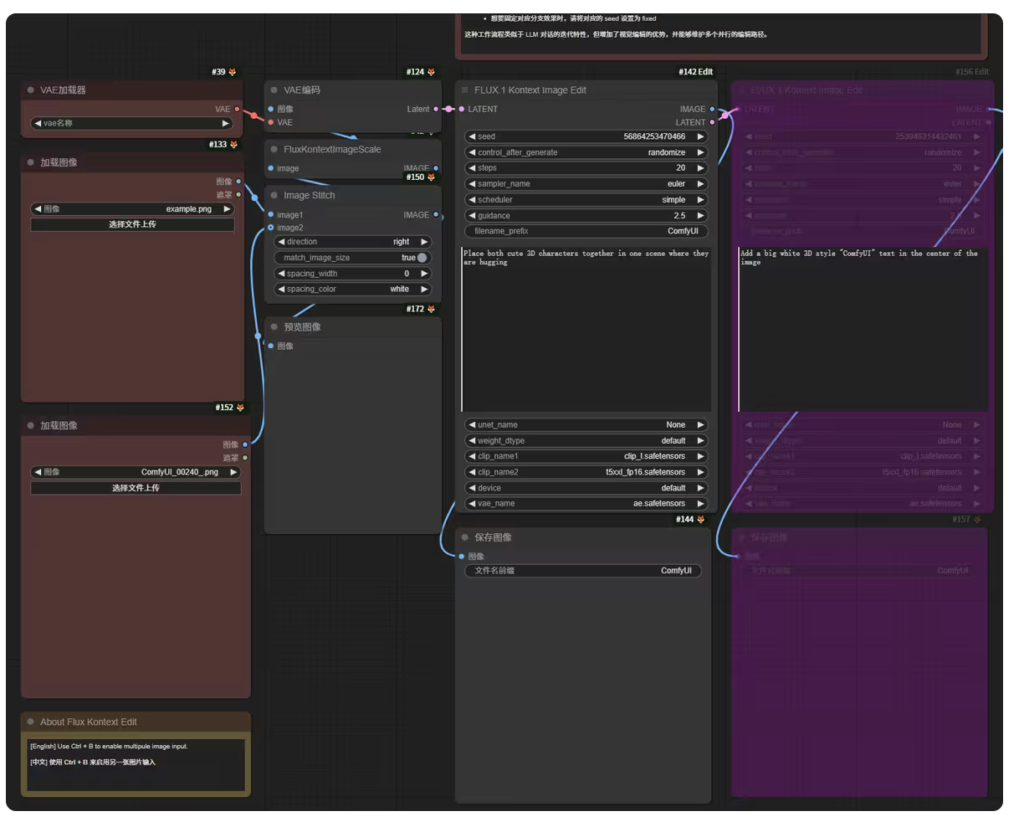

4、FLUX Kontext Dev(基础)版本工作流详解

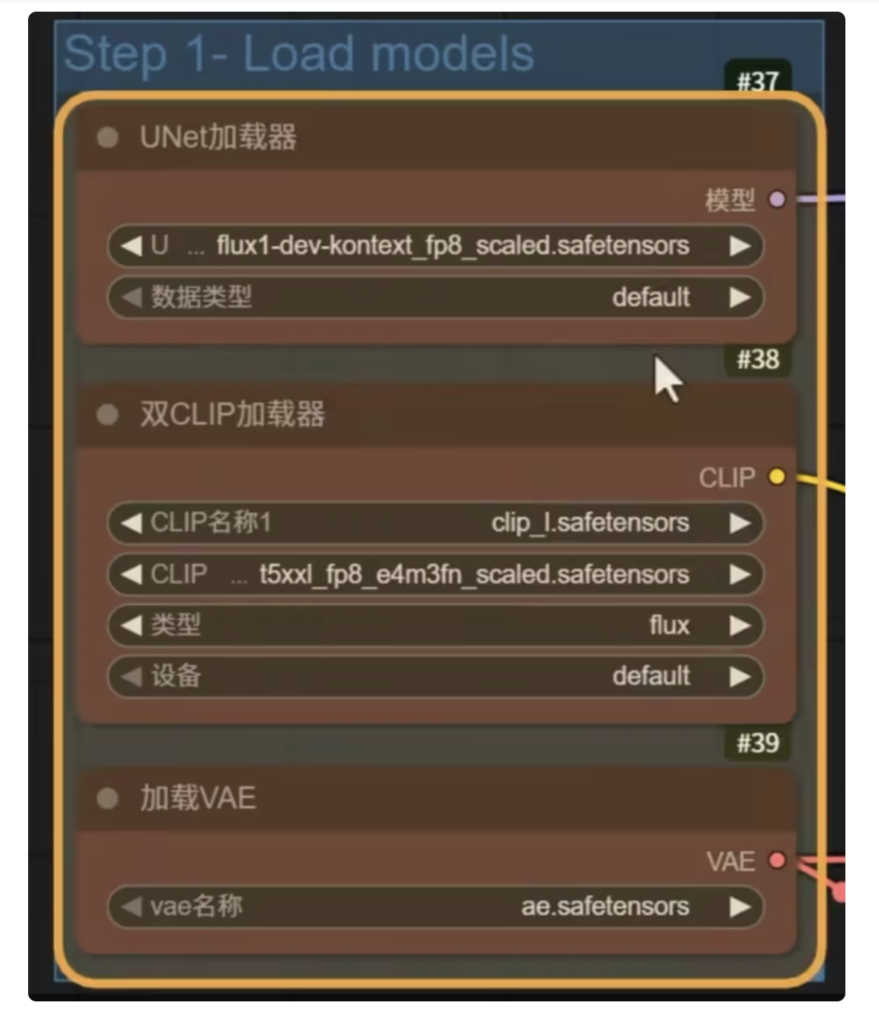

a、加载模型

大模型(UNET模型):

- flux1-dev-kontext_fp8_scaled.safetensors

vae模型:

- ae.safetensor

CLIP模型:

- clip_l.safetensors

- t5xxl_fp16.safetensors 或者 t5xxl_fp8_e4m3fn_scaled.safetensors

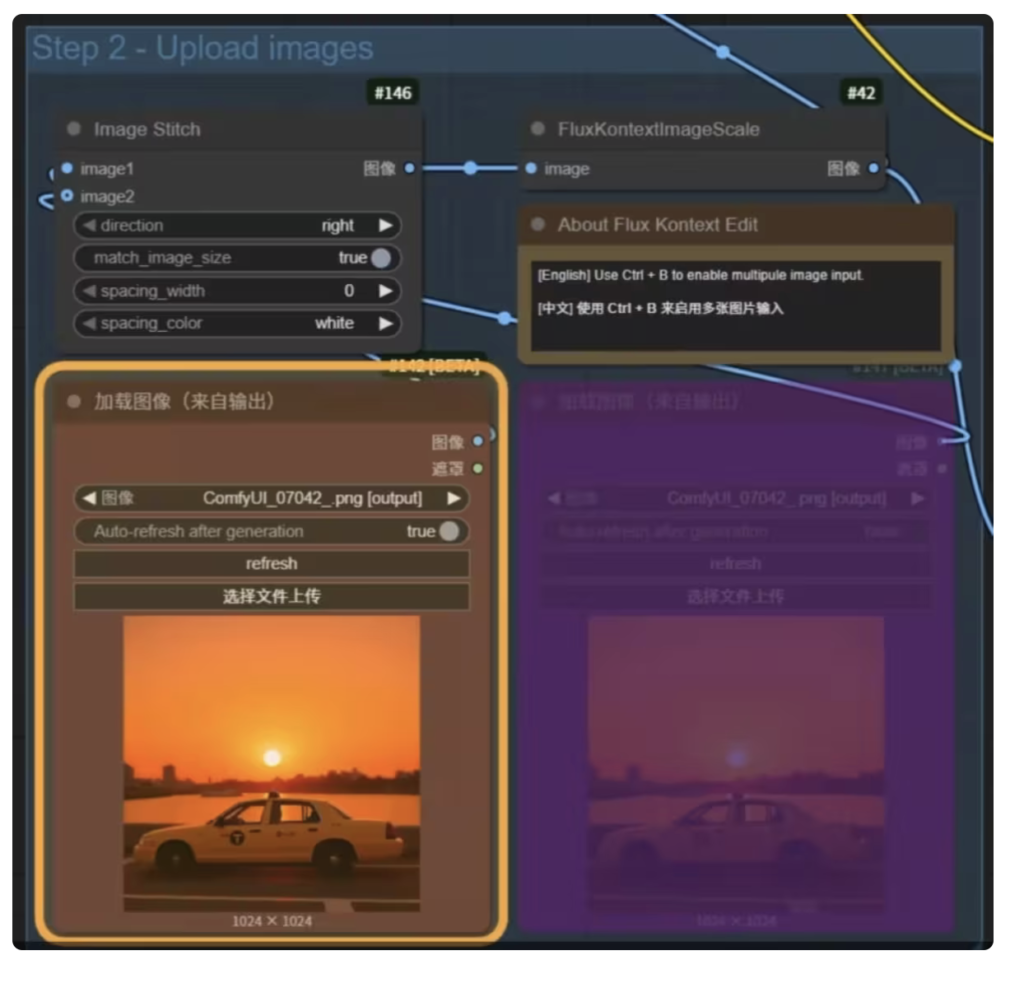

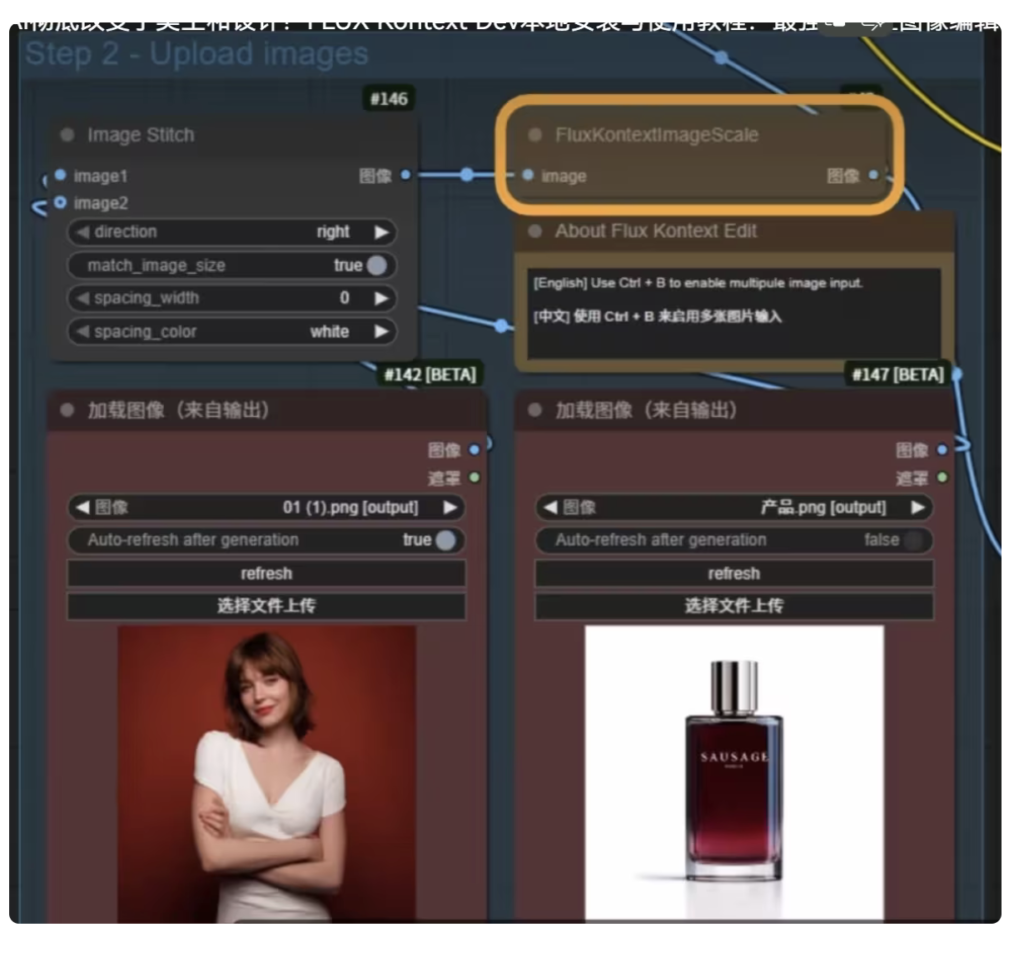

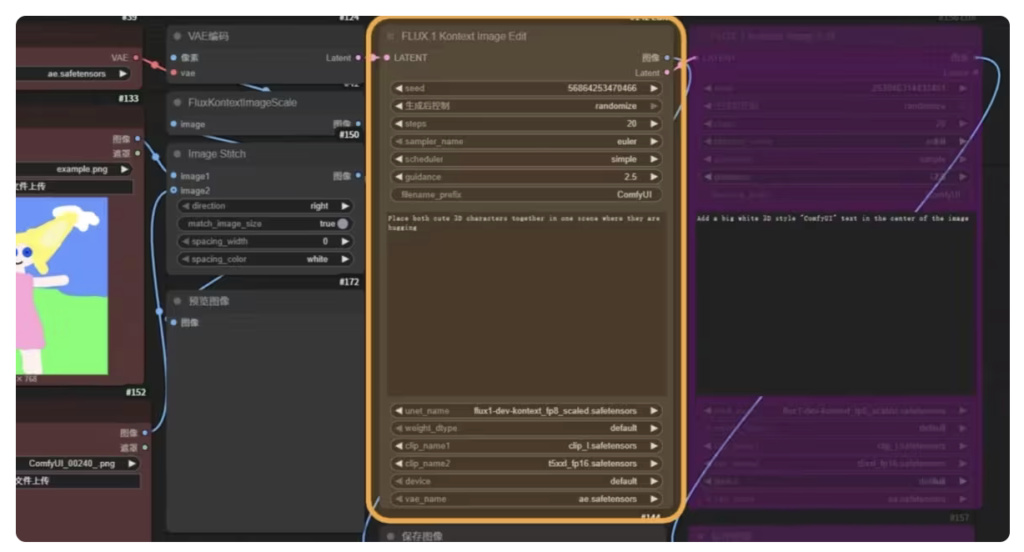

b、上传图片

上传一张给Kontext进行编辑或参考的图片

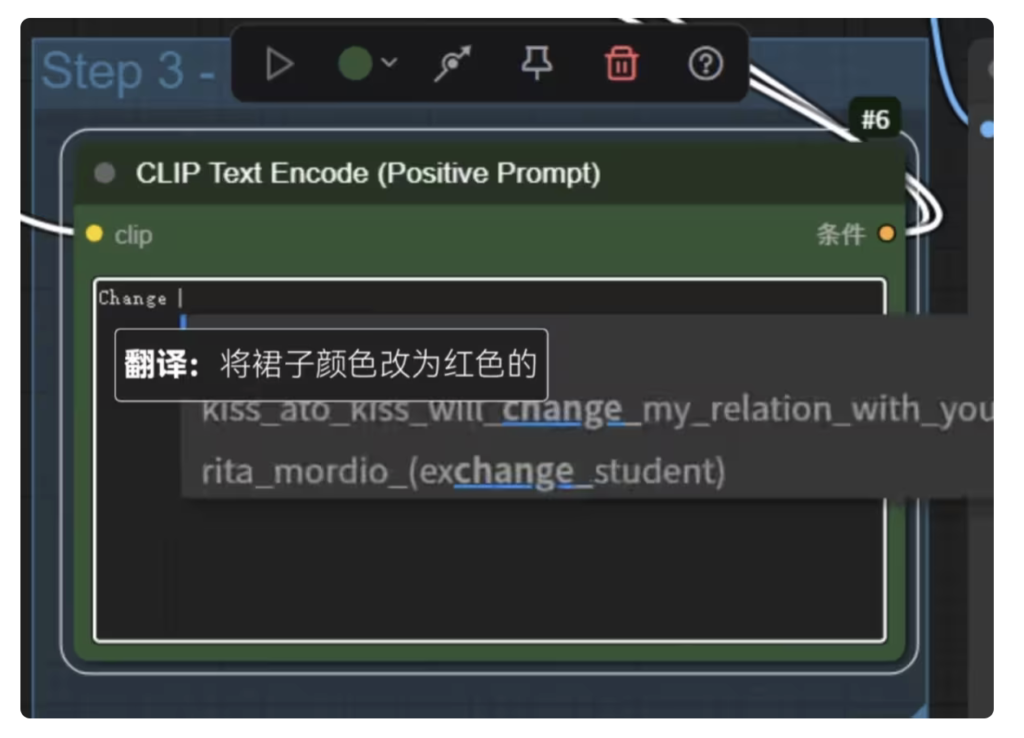

c、输入提示词

提示词就是你命令Kontext做什么事,比如“将女人的裙子颜色变为红色的。”

d、点击运行输出图像

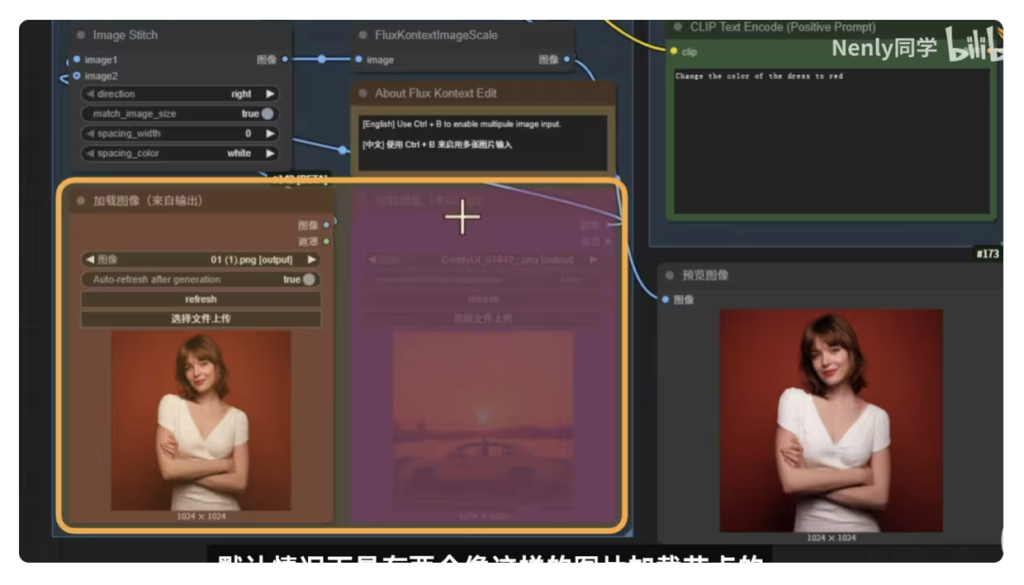

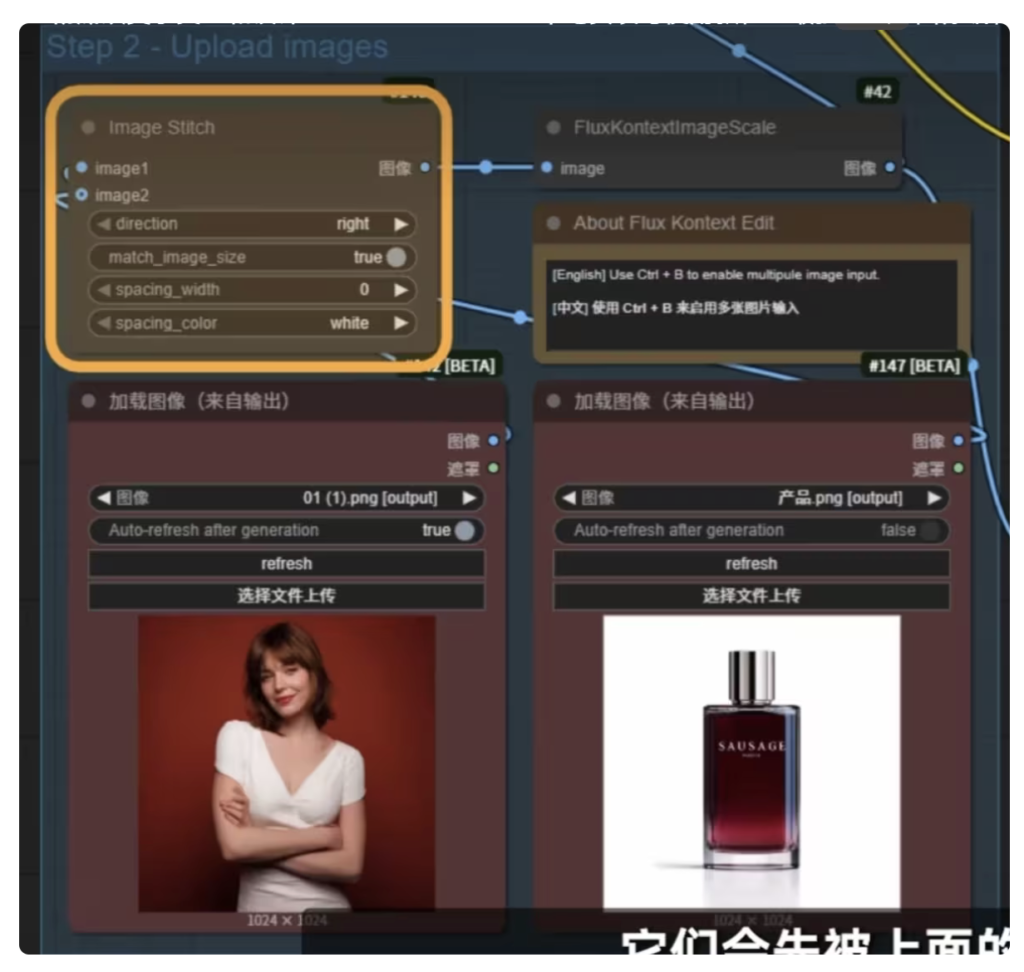

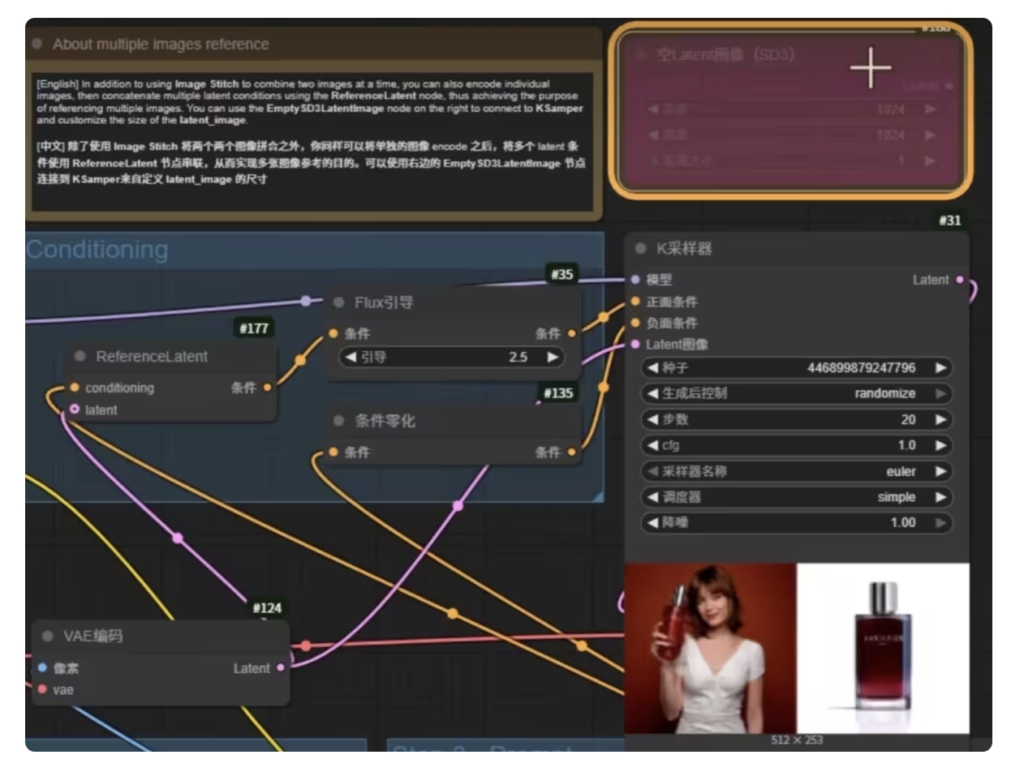

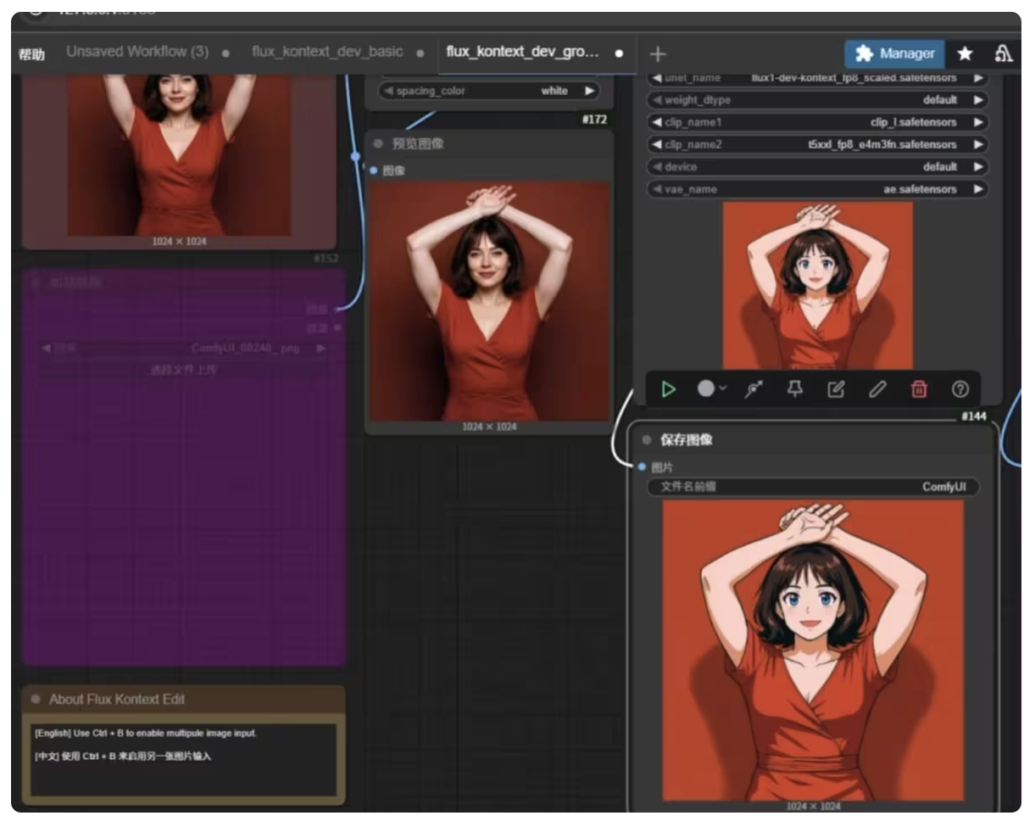

e、开启多图融合效果

Ctrl+B:启动/忽略节点 (可以在这个workflow上看到有一个upload节点被忽略了)

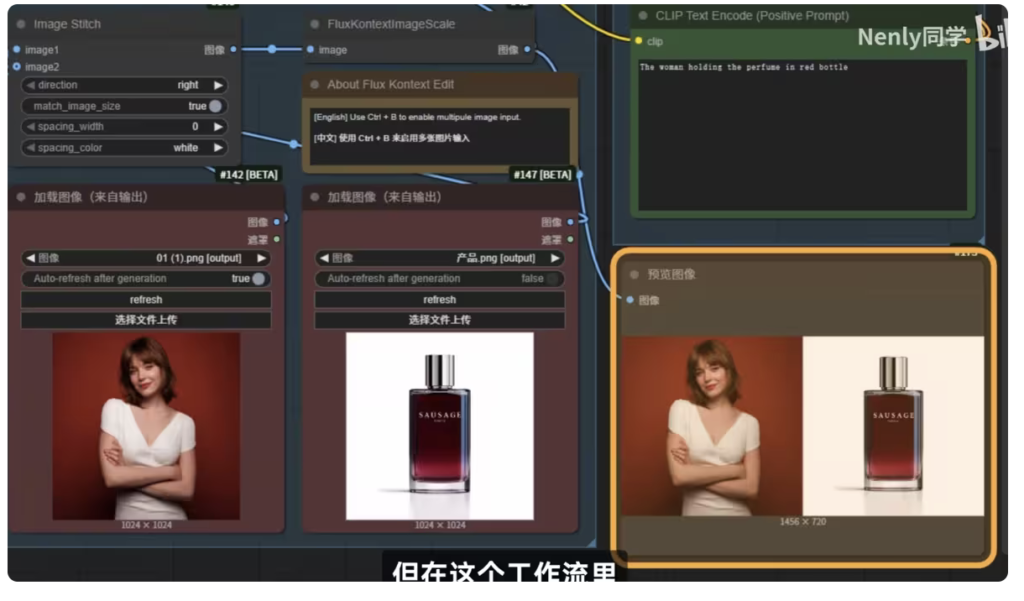

上传图像

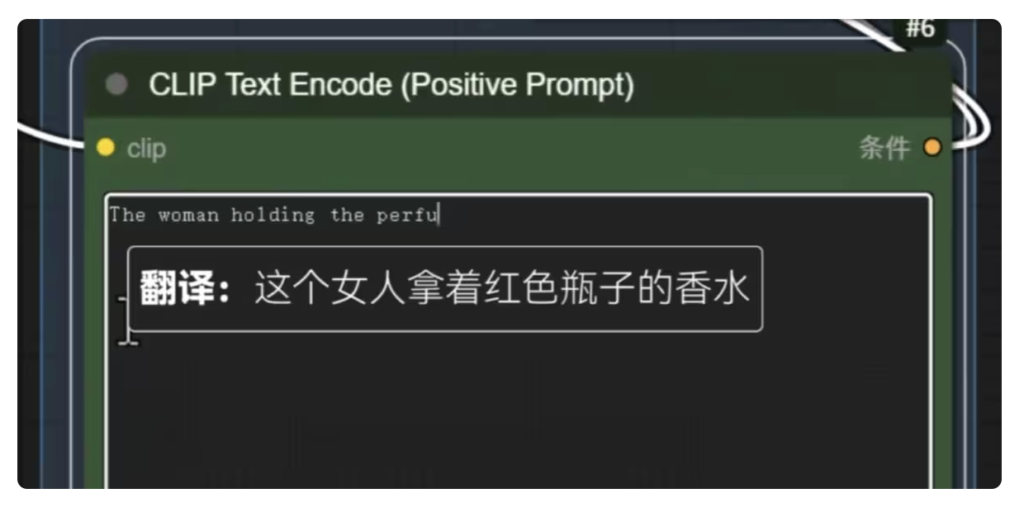

输入提示词,将两张图关联起来,比如“这个女人拿着红色瓶子的香水”

他们就会被“图像缝合”(Image Stick)节点“拼”在一起。

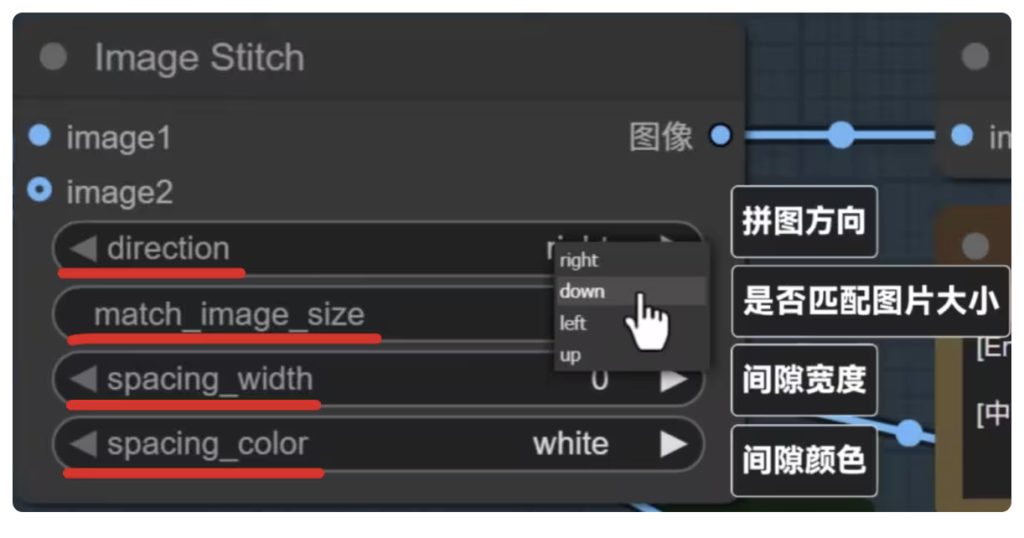

- Direction:拼图方向

- Match_image_size:是否匹配图片大小

- spacing_width:间隙宽度

- Spacing_color:间隙颜色

可以在右下角预览拼图的结果,但是在这个工作流中,怎么拼都不影响Kontext最终执行生成的方式。

然后被后面这个针对Kontext的“尺寸调节”(FluxKontextImageScale)节点缩放后,一起传输进k采样器中。

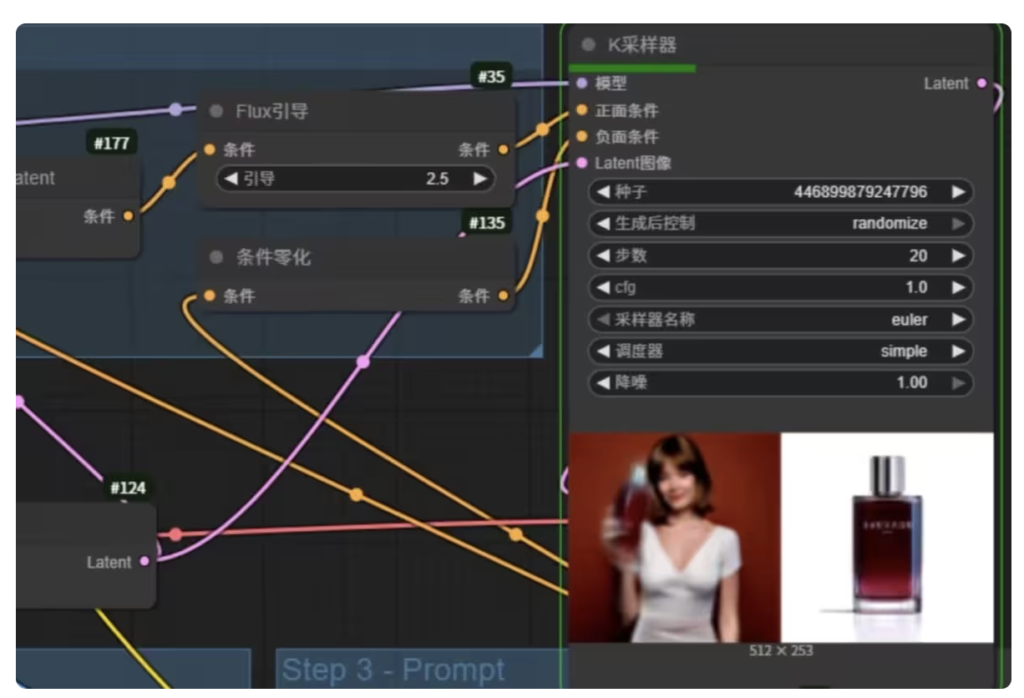

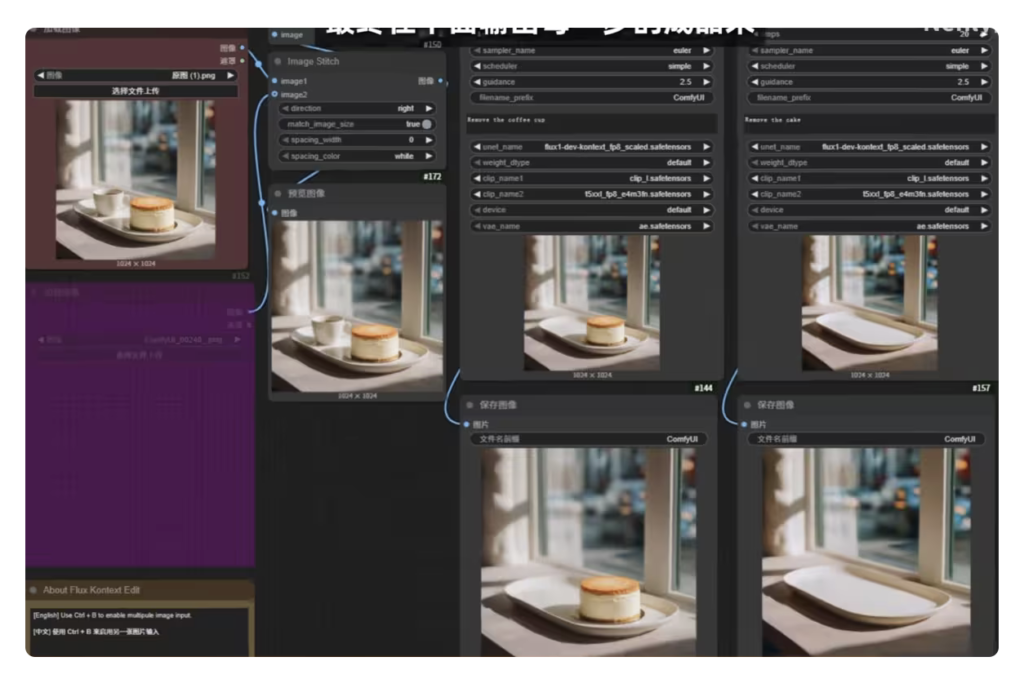

由于是把两张图拼在一起作为Latent传输进k采样器中,这样会导致最后生成出来的图片会是两张合并后的尺寸图像。

在只有一张图像时,输出尺寸与图像一致。

但有两张图像时,输出尺寸就会等于二者拼在一起的尺寸了。

不符合需要,也会在一定程度上降低编辑的效果。

解决办法:

将右上角的“空白Latent”节点恢复使用,将其作为k采样器的Latent。

当然,如果想修改有别于原图的尺寸,也可以通过kLatent节点来进行修改。

5、Flux Kontext Dev(组节点)版本工作流详解

这个工作流将模型等一系列较为复杂的节点都打包成了一个“组节点”

设定一切后,生图

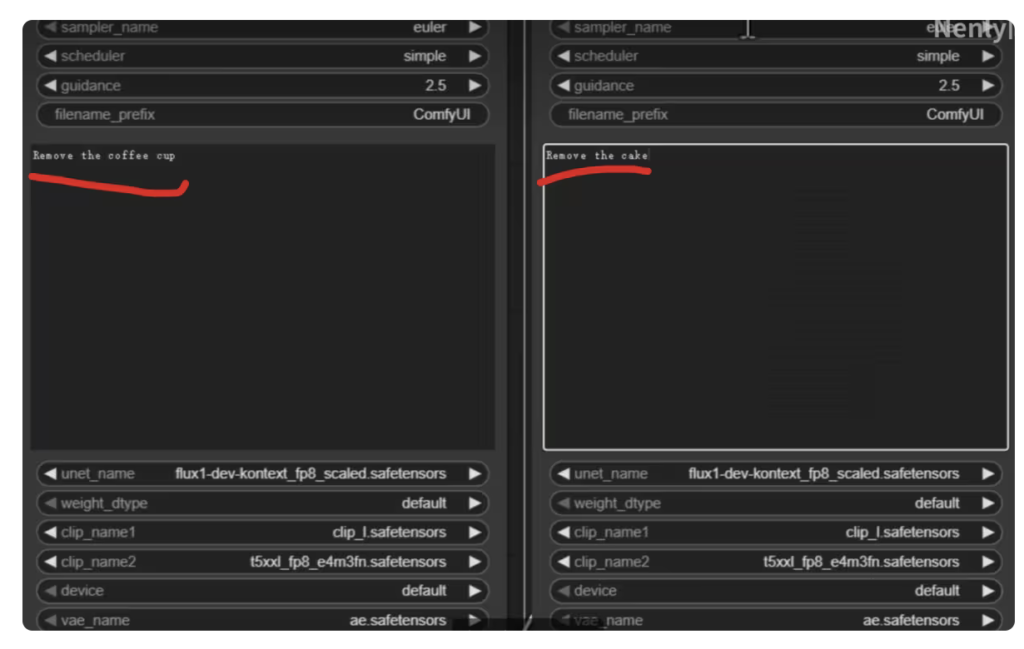

“组节点”还可以用来进行Kontext里的“多轮次编辑”

比如第一次去掉杯子,第二次去掉蛋糕

小贴士:

在输入的所有信息(包括种子)相较于上一次生成都不变的情况下,ComfyUI会直接输出上一次生成的结果,不进行额外采样。也就是固定随机种子,输入前的参数不变,不进行额外采样。