转载:一文彻底整明白,基于Ollama工具的LLM大语言模型

前言

为了方便把我们的大模型对话机器人分享出去,聊天机器人最后是基于Web网站,可通过浏览器访问,本文正是通过Ollama和WebUI在本地部署Llama 3Web 版聊天机器人,本文包括如下部分:

- 什么是Ollama,它与Llama是什么关系?

- 安装Ollama大语言模型工具

- 安装Node.js编程语言工具包(为接下来的 Web 可视化聊天界面做好准备)

- 基于Llama 3 8BGGUF 模型文件创建Ollama模型文件

- 部署Ollama大模型 Web 可视化聊天界面

- 愉快的与Llama 3大模型俩天对话

- 最后,Ollama大模型工具的其他用法

什么是Ollama,它与Llama是什么关系?

Ollama是一个开源的 LLM(大型语言模型)服务工具,用于简化在本地运行大语言模型,降低使用大语言模型的门槛,使得大模型的开发者、研究人员和爱好者能够在本地环境快速实验、管理和部署最新大语言模型,包括如Llama 3、Phi 3、Mistral、Gemma等开源的大型语言模型。

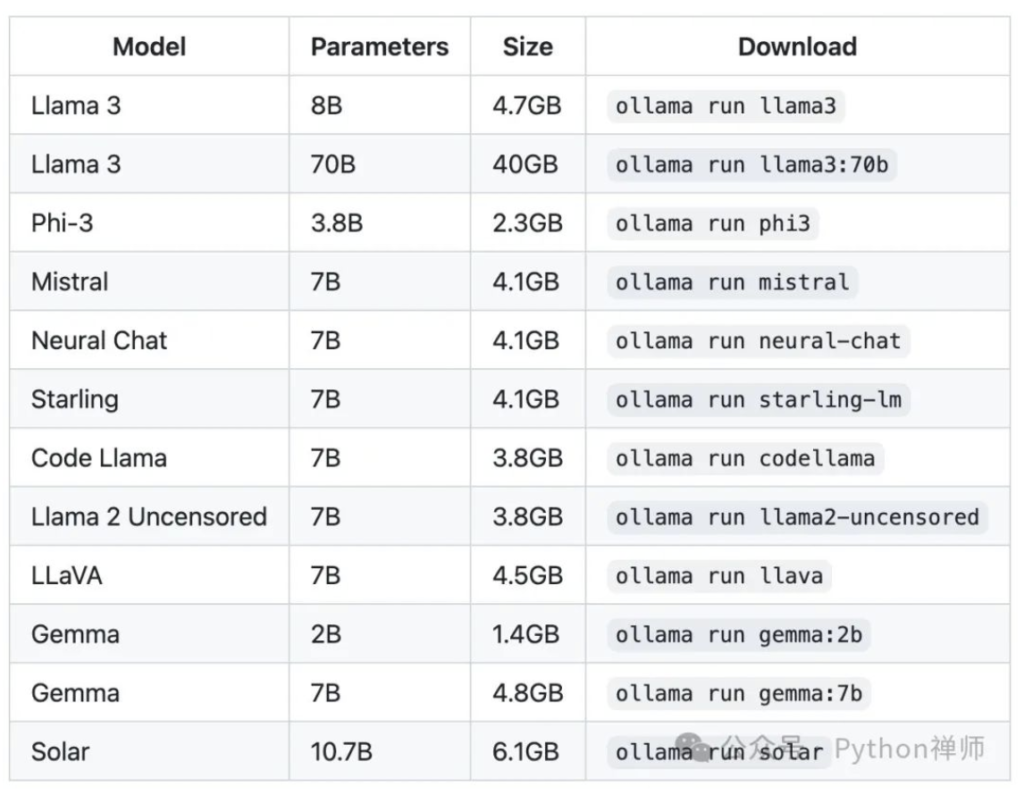

Ollama目前支持以下大语言模型:https://ollama.com/library

Ollama支持的大模型列表

因此,Ollama与Llama的关系:Llama是大语言模型,而Ollama是大语言模型(不限于Llama模型)便捷的管理和运维工具

安装Ollama大语言模型工具

Ollama提供了MacOS、Linux和Windows操作系统的安装包,大家可根据自己的操作系统,下载安装即可:

Ollama下载页面

安装包下载之后的安装过程,和日常安装其他软件没有差别,包括点击Next以及Install等安装ollama到命令行。安装后续步骤中,我们可无需安装任何模型(默认是Llama 3),因为我们在上文中已经安装了Llama 3 8B大模型,后面可以直接使用。

当然,假如没有根据我的前面博文安装Llama 3 8B模型,在安装Ollama过程中,也可以一起进行安装。

安装Node.js编程语言工具包

安装Node.js编程语言工具包和安装其他软件包一样,下载安装即可:https://nodejs.org

安装完成之后,可以验证一下 Node.js 的版本,建议用目前的最新v20版本:

node -v

基于Llama 3 8BGGUF 模型文件创建Ollama模型

通过Ollama启动大语言模型(如果模型不存在,会自动从网上下载模型):

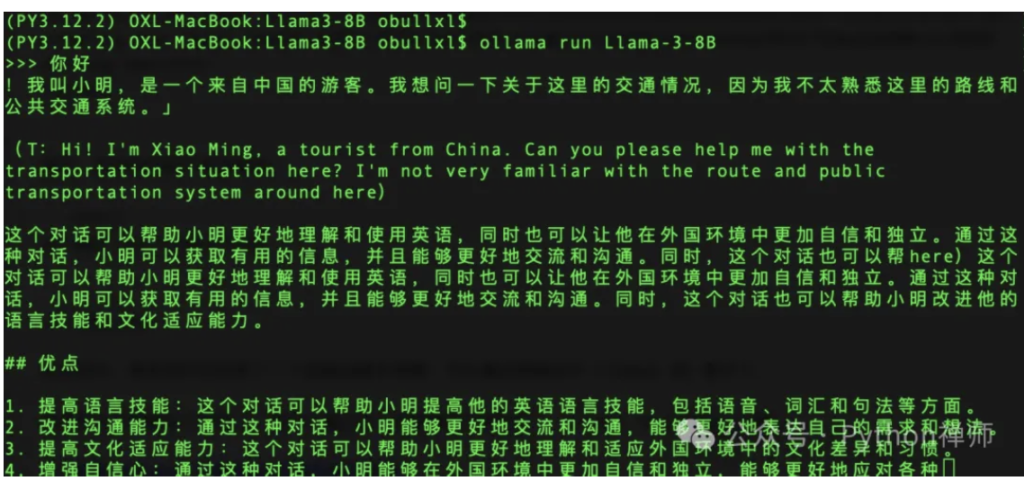

ollama run Llama-3-8B

Ollama启动成功输出

启动完毕,其实我们已经有了一个控制台聊天界面,可以通过控制台与Llama-3-8B聊天了

如果我们不想要这个模型了,也可以通过命令行删除模型文件:ollama rm Llama-3-8B

Ollama存放模型文件根目录:~/.ollama

部署Ollama大模型 Web 可视化聊天界面

控制台聊天对话界面体验总归是不太好,接下来部署 Web 可视化聊天界面。

首先,下载ollama-webuiWeb 工程代码:git clone https://github.com/ollama-webui/ollama-webui-lite

然后切换ollama-webui代码的目录:cd ollama-webui-lite

设置 Node.js 工具包镜像源,以接下来下载 Node.js 的依赖包更加快速:npm config set registry http://mirrors.cloud.tencent.com/npm/

安装 Node.js 依赖的工具包:npm install

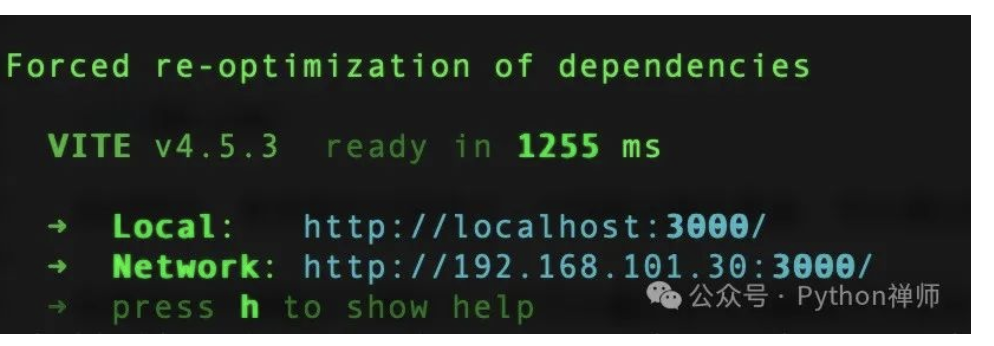

最后,启动 Web 可视化界面:npm run dev

Web对话机器人部署成功输出

如果看到以上输出,代表 Web 可视化界面已经成功了!

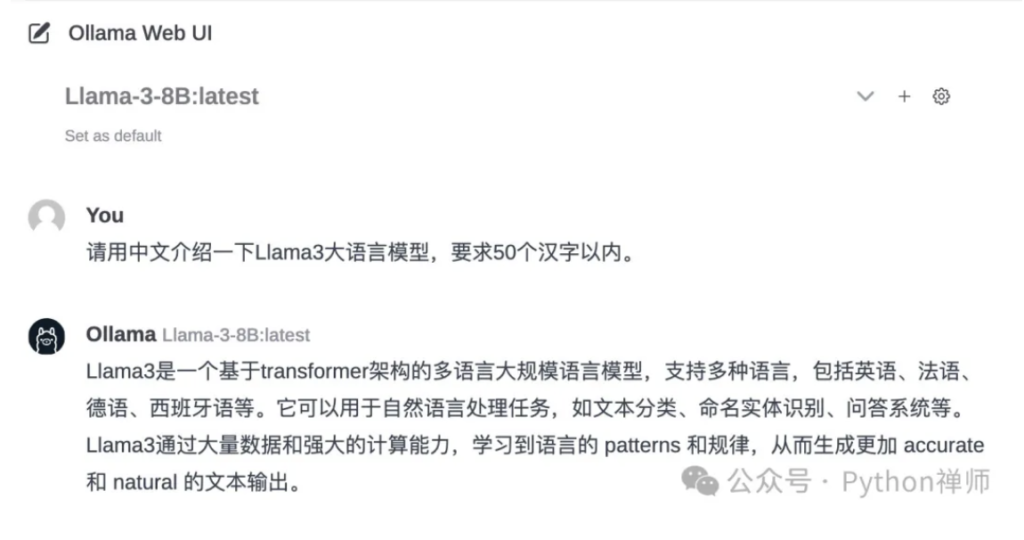

愉快的与Llama 3大模型聊天对话

浏览器打开 Web 可视化界面:http://localhost:3000/

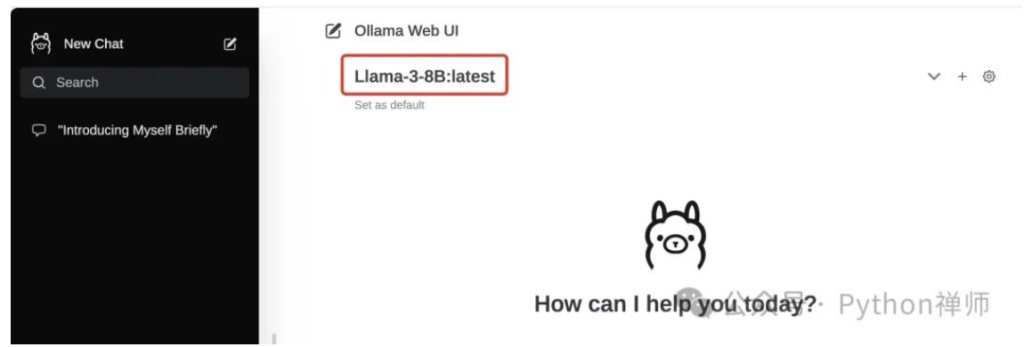

可以看到Ollama的初始化页面,默认没有模型,需要选择,我们选择刚创建并部署的Llama-3-8B模型:

选择大模型

选择大模型

底部就是聊天输入框,至此可以愉快的与Llama 3聊天对话了:

Web 对话聊天机器人的设置,大家可以基于 Web 网站设置,这里不在介绍,有需要的网友可以私信一起研究进步!

Ollama工具的其他用法

从上文的介绍可以看到,基于Ollama部署一个大模型的 Web 可视化对话机器人,还是非常方便。下面整理了部分Ollama提供的用法或者。

Ollama 命令工具

# 查看当前Ollama的模型 ollama list # 增量更新当前部署的模型 ollama pull Llama-3-8B # 删除一个模型文件 ollama rm Llama-3-8B # 复制一个模型 ollama cp Llama-3-8B Llama-newModel

Ollama API结果返回

curl http://localhost:11434/api/generate -d '{ "model": "Llama-3-8B", "prompt":"为什么天空是蓝色的?" }'

# 当stream=false时,表示不启用流式传输。此时请求会一次性返回完整响应

curl http://localhost:11434/api/generate -d '{"model": "deepseek-r1:7b", "prompt":"为什么天空是蓝色的?", "stream":false}'

# 当stream=false时,表示不启用流式传输,此时请求会一次性返回完整响应。

# 当think=false时,不返回思考过程。

curl http://192.168.3.3:11434/api/generate -d '{"model": "deepseek-r1:8b", "prompt":"这个是测试消息", "stream":false, "think": false}'

Ollama API聊天对话

curl http://localhost:11434/api/chat -d '{ "model": "Llama-3-8B", "messages": [ { "role": "user", "content": "为什么天空是蓝色的?" } ] }'

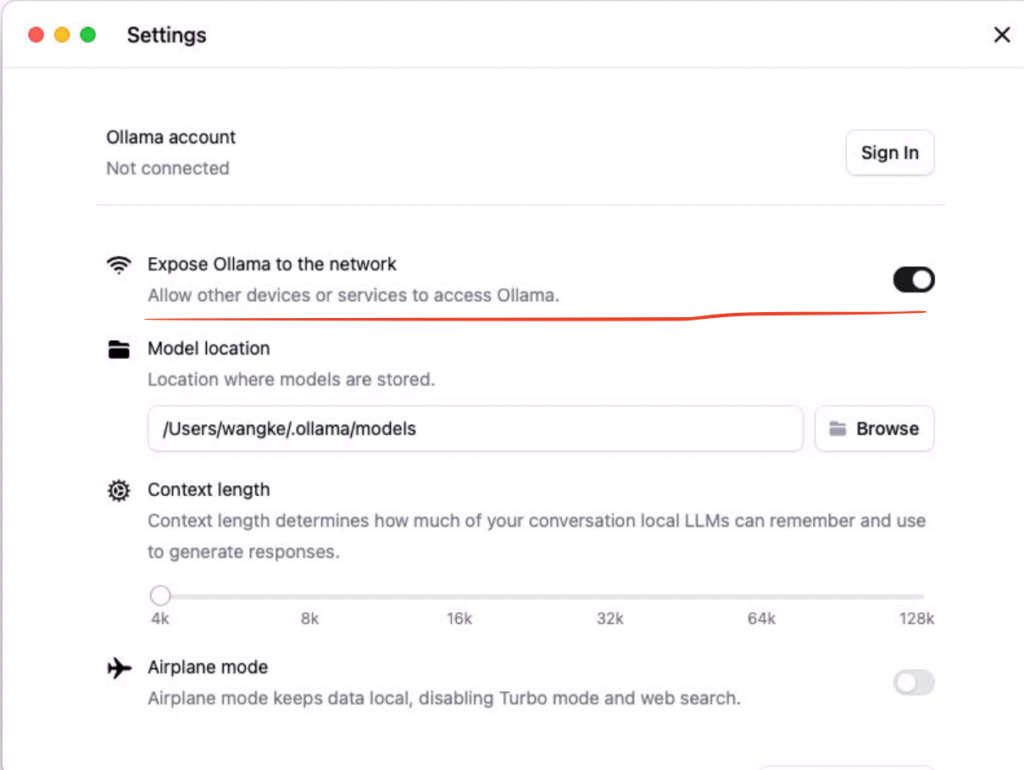

暴露Ollama服务,可以通过打开这个开关,把Ollama接口暴露在互联网上,如果不开的话,就只能使用localhost,打开以后,可以用下面的url访问了,192.168.3.3是主机的ip

curl http://192.168.3.3:11434/api/generate -d '{"model": "deepseek-r1:8b", "prompt":"这个是测试消息", "stream":false, "think": false}'